AI 视频生成正从“视觉奇观”转向工业化生产。通过扩散模型(Diffusion Models)与 Transformer 架构,该技术已能将指令转化为具备物理模拟能力的动态视觉序列,并在商业广告、短视频及影视预演中实现规模化应用。

目前的行业核心矛盾已不再是“能否生成”,而是如何精准控制视觉一致性并平衡算力成本。

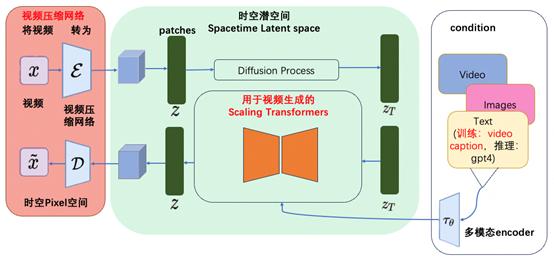

原理:从像素预测转向时空潜在空间

顶尖模型(如 Sora 2、Kling 2.6)不再采用逐帧生成图像的逻辑,而是将视频处理为“时空补丁”(Spacetime Patches)。模型在潜空间(Latent Space)中计算物体在三维空间随时间移动的概率分布,而非单纯预测下一帧像素。

这种机制从根本上解决了早期的“闪烁”问题。由于模型在生成首帧时已规划好未来 10 秒的运动轨迹,因此能处理复杂的流体动力学。例如水杯破碎时的碎片飞溅路径,现在基于物理常识计算,而非随机的像素漂移。

商业级短片构建指南:从纯文本转向管线设计

直接依赖纯文本生成(Text-to-Video)往往导致画面缺乏质感或出现随机形变。高效的生产链路应为:“图像引导 $\rightarrow$ 视频生成 $\rightarrow$ 局部重绘”。

第一步:建立视觉基准(Keyframe Generation)

--seed 值,确保同一场景在不同角度下的光影、材质和色彩高度统一。将这些静态图作为 Image-to-Video 的引导图,可将生成结果的随机性降低 70% 以上,避免在随机抽奖中浪费算力点。

第二步:分段生成与运动控制(Motion Control)

第三步:局部重绘与细节修正(In-painting)

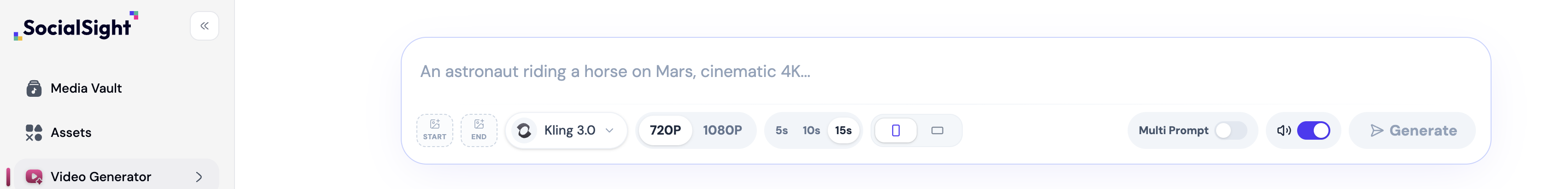

主流工具能力矩阵

不同工具在物理模拟、生成效率与控制精度上存在显著差异,具体对比见下表:

| 维度 | Sora 2 | Kling 2.6 | Wan 2.6 |

|---|---|---|---|

| 核心优势 | 物理模拟最强 / 长视频 | 肢体交互自然 / 效率高 | 私有化部署 / LoRA微调 |

| 成本支出 | 最高 | 中等 | 最低(算力自持) |

| 控制精度 | 高(语义理解) | 中(笔刷控制) | 极高(模型微调) |

商业成本与局限性分析

AI 视频并未完全消除制作成本,而是转移了成本结构。为了获得一个“绝对可用”的 5 秒镜头,制作团队可能需要尝试数百次生成,这种隐形成本在低预算项目中甚至超过了实拍成本。

目前的商业逻辑已由“替代拍摄”转向“替代补拍”:在实拍基础上使用 AI 进行环境扩展(Outpainting)或背景替换,以兼顾真实感与成本。

以下三类场景建议坚持实拍或传统 CG:

- 深层情感微表情:AI 难以模拟具有叙事深度的复杂情感,画面往往过于平滑。

- 严格的 VI 色彩管理:对于要求色号 1% 偏差都不能有的品牌视觉,AI 的随机性难以管控。

- 长时线逻辑叙事:在 10 分钟以上的短片中,人物细节的不一致性会严重破坏沉浸感。

Q: 为什么不能直接用文本生成视频,而要走“图 $\rightarrow$ 视频”管线?

因为纯文本生成具有极高的随机性(Stochasticity),难以保证角色在不同镜头间的一致性。通过先生成高精关键帧并锁定种子值,可以将视觉基准固定,大幅提升工业化生产的效率。

Q: 如何在 AI 视频中有效控制物体的运动轨迹?

建议采用“笔刷区域标注 + 位移向量设置”的组合方式。在专业工具中通过掩码(Mask)限定运动区域,并精准设置 X/Y 轴的移动数值,同时将运动强度(Motion Strength)维持在 3-5 之间,以平衡动态感与形变风险。

Q: AI 视频生成的算力成本如何优化?

核心在于减少“随机抽奖”次数。通过构建私有的 LoRA 资产库固定风格,并在视频生成前使用低分辨率草图进行构图确认,最后才进行高分辨率渲染,可显著降低无效生成的算力损耗。

落地建议

不要追求“一键生成”的幻想,而应构建个人或企业的“AI 资产库”。通过 LoRA 模型固定常用场景与人物,将 AI 定位为高效的镜头助理而非全能导演。

现阶段,建立一套“图像 $\rightarrow$ 视频 $\rightarrow$ 修正”的标准化工作流,其商业价值远高于追踪单一工具的版本更新。