AI绘画通过扩散模型或生成对抗网络,将文本提示词转化为具体图像。到2026年3月,这项技术已从随机生成(抽卡)进化为高可控的生产力工具,覆盖了商业原画与个人创作的多个环节。

这种转变重新定义了“创作”。过去,创作依赖对笔触、色彩和构图的物理掌控;现在,核心能力转向对审美标准的定义和提示词逻辑的调度。这种阵痛在技术跃迁中很常见,但它确实要求创作者从执行端向决策端转移。

核心原理:潜空间与噪声的博弈

主流工具如Midjourney v7或Stable Diffusion 3.5基于扩散模型(Diffusion Model)。其逻辑是:AI在训练阶段学习如何将清晰图片逐步加入噪声直到变为乱码;生成时则反向操作,根据文本引导剔除噪声,还原出图像。

关键在于“潜空间”(Latent Space)。AI并非在像素层面操作,而是在压缩的数学空间中寻找特征。当你输入“赛博朋克风格的上海街道”时,AI在潜空间定位“赛博朋克”与“上海”两个向量的交集,再解码为可见图像。由于潜空间基于统计概率而非物理逻辑,AI有时会生成多余手指,因为在概率分布中,手指数量并不像人类认知那样具有严格的唯一性。

实操指南:构建高质量商业图像的链路

在2026年的专业标准下,简单的词组堆砌已无法满足商业需求。高质量图像需经过“结构化提示词 → 参数调优 → 局部重绘 → 分辨率增强”的完整链路。

第一步:结构化提示词构建

避免散漫的句子,采用结构化模版以增强可控性。建议遵循:“主体 + 场景/背景 + 艺术风格 + 光影/色彩 + 镜头语言 + 质量词”。

若出现修饰词过多导致主体被忽略的情况,可使用权重语法来增强主体特征:

Midjourney: robot::1.5

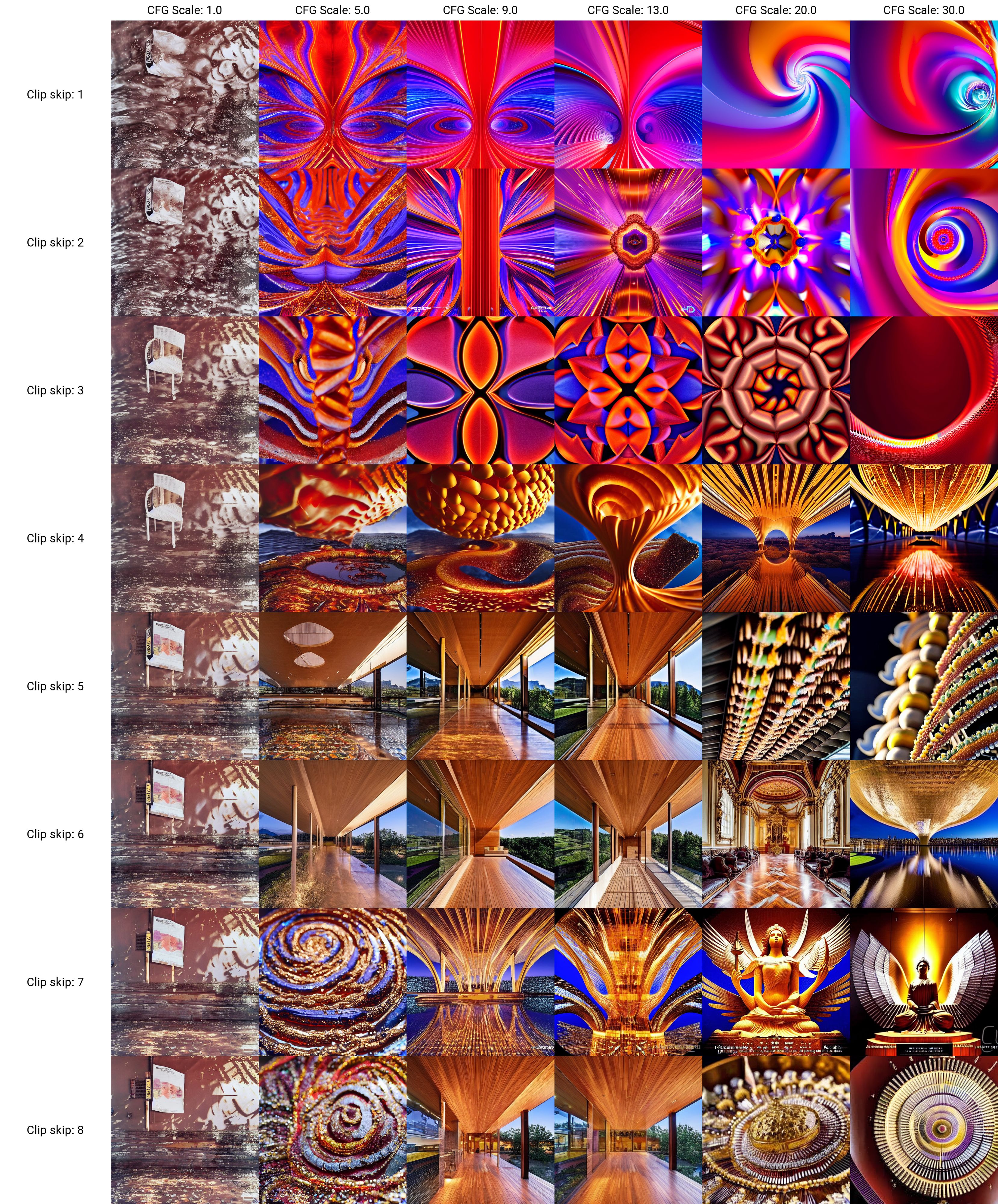

Stable Diffusion: (robot:1.5)第二步:参数配置调优

底图生成后,需通过参数控制随机性。以Midjourney v7为例:

--stylize (s) 调至100-250,使AI严格遵循提示词。2. 增加多样性:在探索阶段将

--chaos (c) 设为20-50,提高出图差异度。3. 调整奇异感:增加

--weird (w) 值以引入不寻常的视觉元素,避免画面过于像素材库照片。

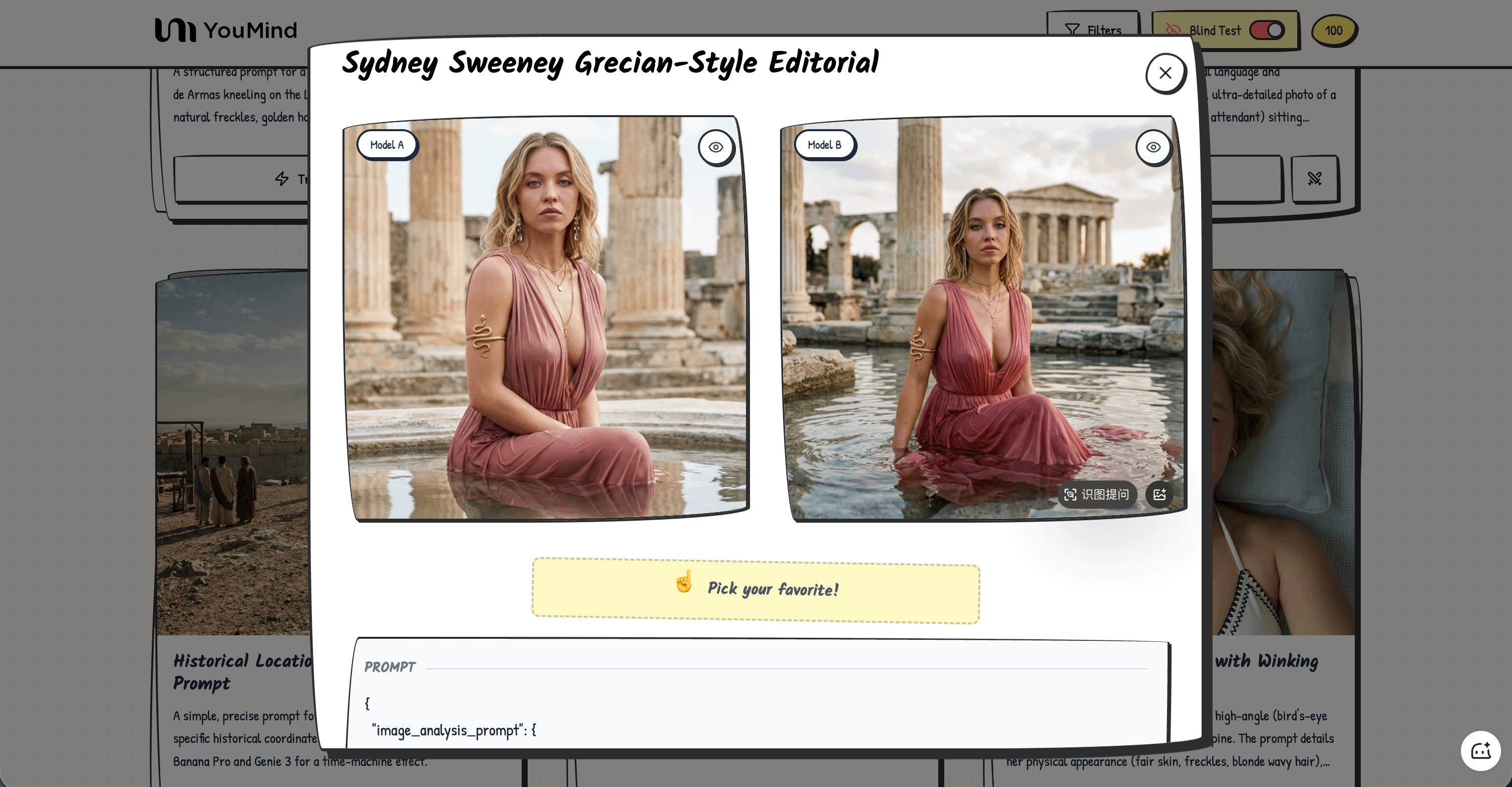

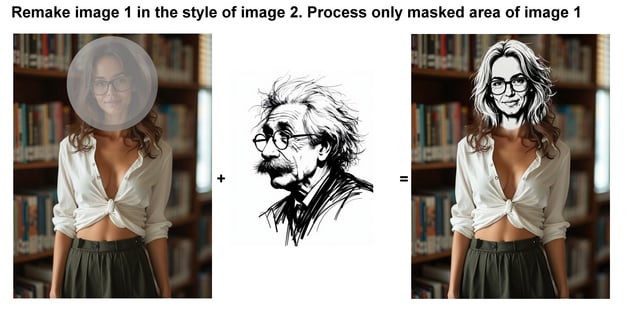

第三步:局部重绘(Inpainting)

局部重绘是区分业余与专业的关键。直接重刷全图会改变整体风格,应针对性修复瑕疵。

第四步:超分辨率与后期精修

原生分辨率通常无法满足大画幅印刷。建议使用Topaz Photo AI或R-ESRGAN 4x+模型进行2x或4x放大。注意避免一次性放大过高,防止出现“塑料感”。最后在Photoshop中通过曲线和色阶微调,去除数字化光泽,提升真实感。

工具选择对比

针对不同的商业需求,应选择最适合的工具链路:

| 工具 | 核心优势 | 主要局限 | 适用场景 |

|---|---|---|---|

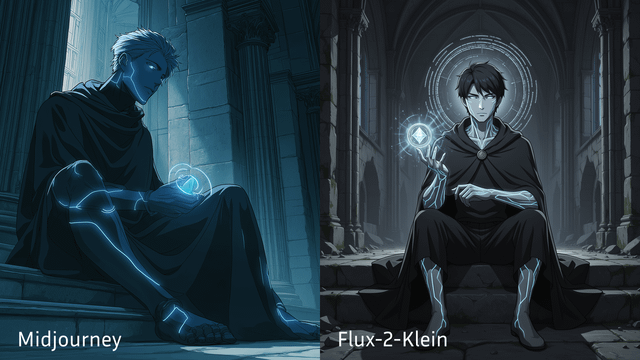

| Midjourney v7 | 审美极高,出图速度快 | 封闭生态,像素级控制力弱 | 概念图、社交媒体配图 |

| Stable Diffusion 3.5 | 开源,控制力极强 (ControlNet) | 学习曲线陡峭,硬件要求高 | 游戏原画、电商产品图 |

| Flux.1 | 文字生成精准,人体结构稳 | 推理速度较慢,插件较少 | 含文字的海报设计 |

AI绘画的边界与局限

AI无法完全替代需要“绝对确定性”和“深层情感逻辑”的任务。

- 工业设计:要求极高精度。若螺丝钉尺寸需精确到0.1毫米,AI的随机性会导致方案无法直接用于生产,必须配合CAD工具。

- 精神内核:AI能模拟笔触,但无法模拟创作者在特定生命体验下的情感挣扎。完全依赖AI的作品往往因“过于完美”而显得空洞。

- 交互逻辑:UI/UX涉及复杂的用户心理预期,AI目前仅能生成