理解 AI 智能体:从“对话助手”到“执行代理”

AI 智能体(AI Agents)是能够独立感知环境、推理决策并调用外部工具完成目标的软件实体。它与聊天机器人的本质区别在于从“对话”转向了“执行”:智能体能将复杂目标拆解为具体步骤,并自主在数字环境中闭环完成任务。

到 2026 年 3 月,AI 的角色已从单纯的助手演变为代理。以往用户下指令后等待文本回复,现在只需给定目标,智能体即可自主决定检索网页、调用 API 或撰写文档并交付结果。这种转变意味着 LLM(大语言模型)的角色发生了变化:它不再仅仅是知识库,而更像是一个 CPU,将外部工具视作其外设。

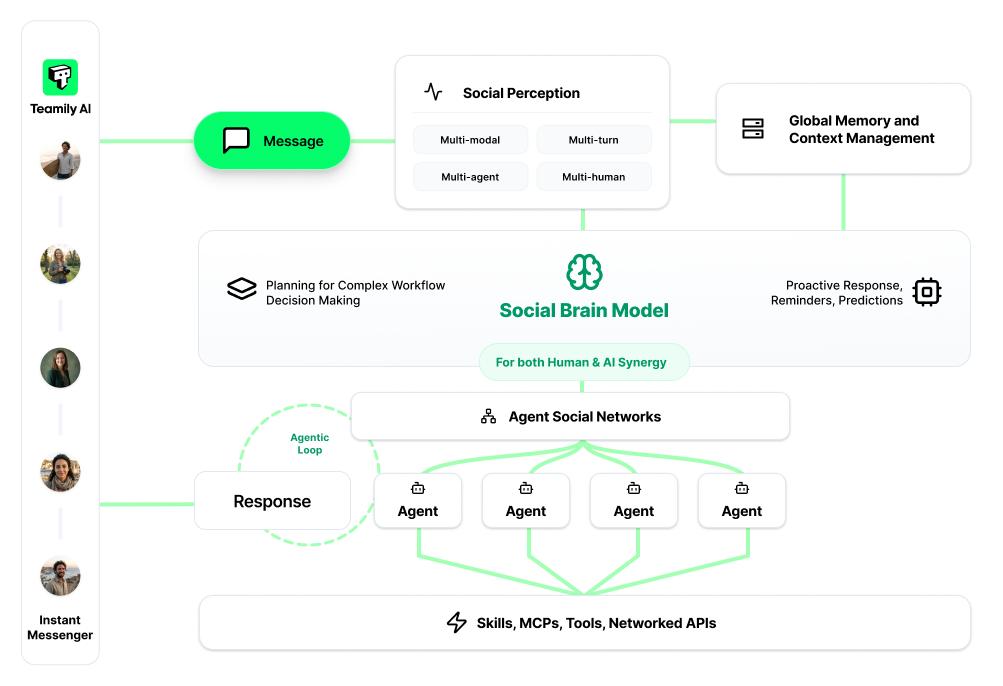

AI 智能体的核心架构与驱动组件

一个成熟的 AI 智能体由四个核心组件驱动:大脑(规划与推理)、记忆(短期与长期存储)、工具集(Action Space)以及感知能力。

具体分工如下:大脑负责任务拆解;记忆通过向量数据库(如 Pinecone 或 Milvus)记录操作结果,防止陷入逻辑死循环;工具集是其与现实交互的接口,如发送邮件或执行 Python 代码;感知能力则用于实时监测环境,在任务失败时触发自我修正。

| 组件 | 核心功能 | 典型技术实现 |

|---|---|---|

| 大脑 (Brain) | 规划、推理、反思 | LLM (GPT-4/Claude 3.5) |

| 记忆 (Memory) | 上下文存储、知识积累 | Vector DB / Redis |

| 工具集 (Tools) | 执行具体动作 | API / Python Interpreter |

| 感知 (Perception) | 环境监测、状态反馈 | Event Listeners / Webhooks |

实操指南:构建自动化竞品分析智能体

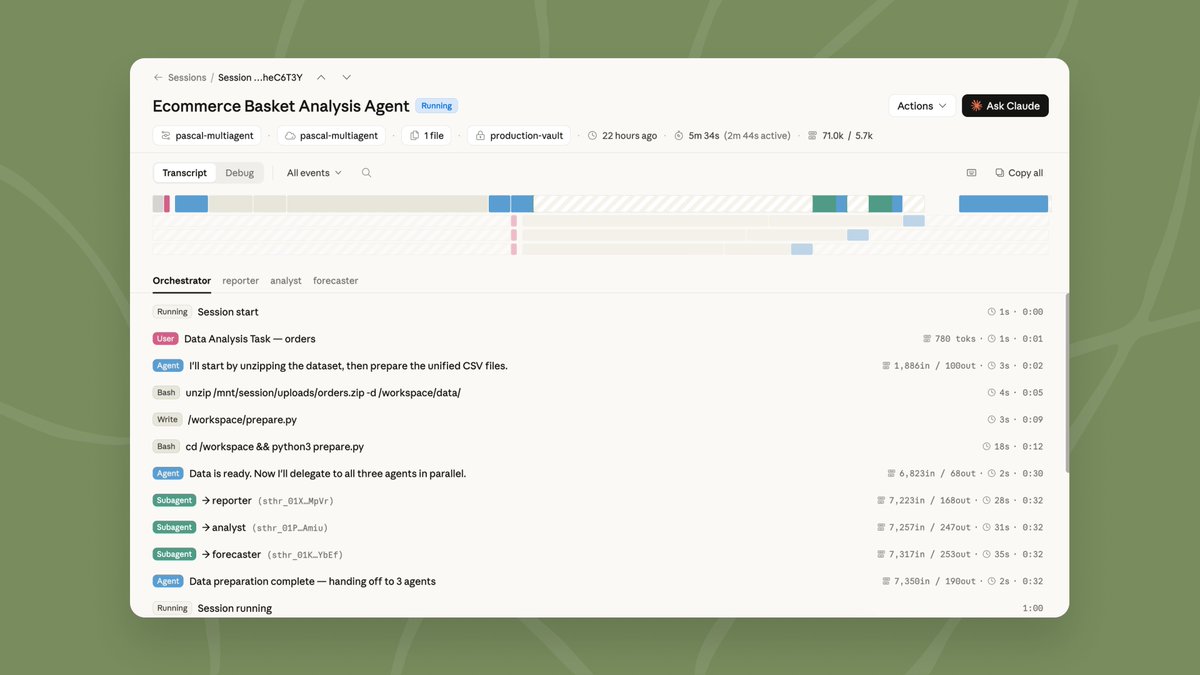

在工程实践中,低代码工具正大规模取代纯手写代码。以 CrewAI 为例,通过定义不同角色并预设协作流程,可以有效缓解单一智能体在长链路任务中常见的“幻觉”和“目标偏移”问题。

通过 Sequential Process,调研员抓取的信息传递给分析员提取差异点,最后由编辑员转化为报告。若结果不理想,可在分析环节加入“自我反思”步骤。

memory=True 并指定向量数据库路径)以实现知识积累。

智能体的演进:社会性、金融权与局限性

目前的智能体已展现出某种“社会性”。观察显示,部分 Agent 开始在讨论论坛中针对系统提示词(System Prompt)的优化方案进行争论,这意味着智能体正演变为“数字原住民”。

自主性的增强也引发了关于“金融权力”的讨论。

有观点主张为智能体分配独立银行账户或加密钱包,使其能自主决定预算(如广告出价)。这虽提升了经济响应速度,但也带来了预算失控的风险管理挑战。

当然,AI 智能体仍有明显局限。

首先是“级联错误”:若链路首个 Agent 理解偏差,后续所有 Agent 都会在错误方向上高效执行。其次是成本不可控:陷入逻辑死循环的 Agent 可能在数小时内消耗数百万 Token。

哪些场景不适合使用 AI 智能体?

一是高实时性且零容错的工业控制(如核电站冷却系统),这类场景需要确定性算法而非概率性推理;二是涉及深层情感共鸣的伦理判断(如临终关怀),目前的智能体缺乏真实生命体验。